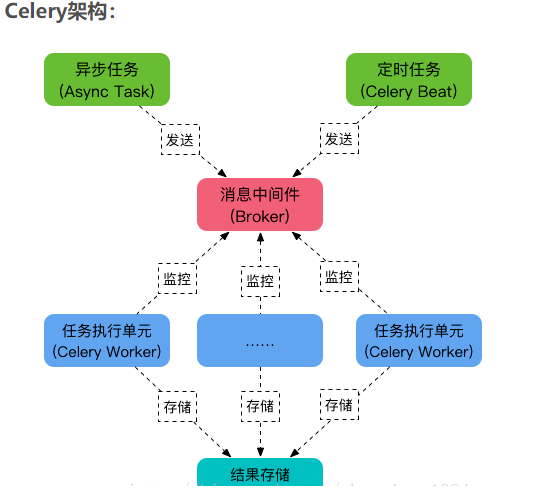

Django Celery动态配置定时任务 Django+Celery实现动态配置定时任务的方法示例

blue_boy 人气:0哈喽,今天给大家分享一篇Django+Celery实现动态配置定时任务,因为最近也是无意间看到一位大佬关于这块的文章,然后自己觉得不错,也想学习写一下,然后最终实现功能是在前端页面统一管理计划任务,大家可以在admin管理页面设置,也可以在自己写的前端页面删除添加编辑,实时生效,还可以监控这些监控任务是否运行成功失败。

补充:如果大家对celery不熟悉的话,建议先学习celery

一、安装

1.在Linux系统上安装模块

celery (3.1.26.post2) celery-with-redis (3.0) redis (2.10.6) Django (2.1.10) django-celery (3.3.1)

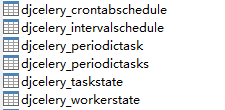

2.迁移生成表

python manage.py migrate

3.查看生成的表,这几张表是上面执行命令后生成的

二、配置

1.添加apps

INSTALLED_APPS = [ 'django.contrib.admin', 'django.contrib.auth', 'django.contrib.contenttypes', 'django.contrib.sessions', 'django.contrib.messages', 'django.contrib.staticfiles', 'djcelery', #这是要添加的 ]

2.配置django时区

LANGUAGE_CODE = 'en-us' TIME_ZONE = 'Asia/Shanghai' USE_I18N = True USE_L10N = True USE_TZ = False

3.Celery配置

BROKER_URL = 'redis://localhost:6379' #代理人 CELERY_RESULT_BACKEND = 'redis://localhost:6379' #结果存储地址 CELERY_ACCEPT_CONTENT = ['application/json'] #指定任务接收的内容序列化类型 CELERY_TASK_SERIALIZER = 'json' #任务序列化方式 CELERY_RESULT_SERIALIZER = 'json' #任务结果序列化方式 CELERY_TASK_RESULT_EXPIRES = 12 * 30 #超过时间 CELERY_MESSAGE_COMPRESSION = 'zlib' #是否压缩 CELERYD_CONCURRENCY = 4 #并发数默认已CPU数量定 CELERYD_PREFETCH_MULTIPLIER = 4 #celery worker 每次去redis取任务的数量 CELERYD_MAX_TASKS_PER_CHILD = 3 #每个worker最多执行3个任务就摧毁,避免内存泄漏 CELERYD_FORCE_EXECV = True #可以防止死锁 CELERY_ENABLE_UTC = False #关闭时区 CELERYBEAT_SCHEDULER = 'djcelery.schedulers.DatabaseScheduler' # 定时任务调度器

4.在你项目的app下面配置celery.py

import os

from celery import Celery,platforms

from django.conf import settings

os.environ.setdefault('DJANGO_SETTINGS_MODULE','blog.settings')

app = Celery('blog')

app.config_from_object('django.conf:settings')

app.autodiscover_tasks(lambda: settings.INSTALLED_APPS)

platforms.C_FORCE_ROOT = True

@app.task(bind=True)

def debug_task(self):

print('Request: {0!r}'.format(self.request))

5.配置刚才app下面的__init__.py文件

from __future__ import absolute_import from .celery import app as celery_app

6.在app下面创建一个tasks.py文件

from blog.celery import app @app.task() def get_date(x,y,s): #这里的函数留意一下,后面会用到 print(s) return x + y @app.task() def get_task(): return 'test' @app.task() def get_command_task(): return 'success'

三、启动

1.进入你项目下面,执行启动worker,Worker是执行任务的单元,它实时监控消息队列,如果有任务就获取任务并执行它。

celery -A autoops worker -l info

2.进入你项目下面,执行启动beat,beat是定时把这个任务扔到队列中

celery -A autoops beat -l info

3.启动你的django项目

python manage.py runserver 192.168.10.133:8001

4.页面展示

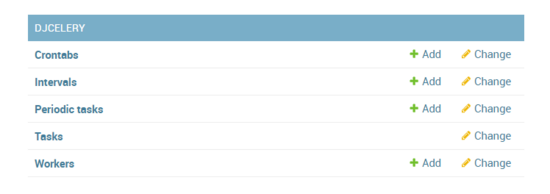

4.1这个是admin页面下的,然后我自己重新写了,大家也可以自己写一个,admin和我自己写的页面实现的功能其实是一模一样的。

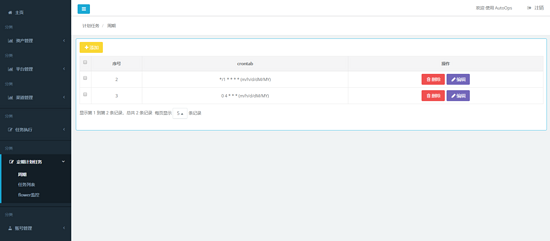

4.2.对应admin页面的crontabs

添加周期

编辑修改周期

5.tasks任务

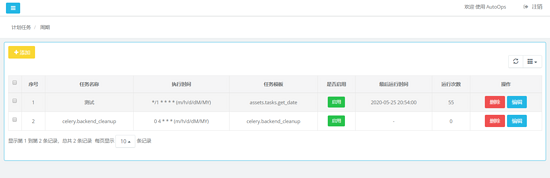

5.1.大家可以看到我添加了一个名为测试的任务,每隔一分钟执行一次,任务模板其实就是你写的tasks文件里面函数

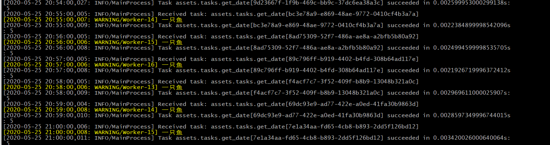

看一下worker进程日志输出

四、监控计划任务

celery作为一个分布式异步任务队列管理工具,通过界面化的方式来进行管控任务的执行状态和查看任务执行结果

flower作为web页面来管理celery后台任务,和任务队列是隔离的,也就是flower的运行与否并不会影响到任务队列的真正执行,但是flower中可以通过API接口来管理celery中的任务执行。

4.1安装flower,监控celery计划任务

pip3 install flower==0.9.2 -i http://pypi.douban.com/simple --trusted-host pypi.douban.com pip install tornado==5.1.1 celery flower -A blog --port=5555 #进入项目目录启动flower

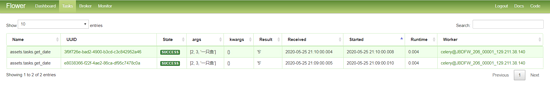

4.2打开浏览器,输入http://ip:5555 查看

Name: 表示该任务的名称,默认规则为该函数的路径规则,例如 {模块名}.{文件名}.{函数名}

UUID: 表示一个唯一字符串ID用于表示该任务

State: 表示该任务的状态,包括: SUCCESS / FAILURE / STARTED / RECEIVED

SUCCESS 表示该任务执行完毕且成功

FAILURE 表示该任务执行失败

STARTED 表示该任务正在执行

RECEIVED 表示该任务在worker中,只是被接收而已

args: 表示该任务的列表参数

kwargs: 表示该任务的字典参数

Result: 表示该任务函数的返回结果

Received: 表示该任务在worker接收到的时间

Started: 表示该任务在worker开始执行的时间

Runtime: 表示该任务在worker真正执行的耗时(单位:秒)

Worker: 表示该任务所在的worker名称

总结:django+celery实现的定时任务还是不错的,你可以在前端上查看管理所有定时任务,实时修改生效删除和禁用,所以有需求的话可以去试试。下次再分享啦

加载全部内容