Python+AI让图片动起来

渡码 人气:0前言:

这种技术一般是基于的GAN(生成对抗网络)来实现,今天我给大家分享一个开源项目,能够复现静态图片动起来效果,可以做些有趣的项目,也可以怀念故人。

大家在刷短视频的时候有没有刷到这样的视频,视频里一张静态的人物图片能动起来,如:歪歪头、眨眨眼。

类似于下面这种效果:

最左侧的人物是原始的动作,上面是静态图片。通过AI技术便可以让最左侧人物的动作运用到上面的静态图片上,从而让张图都可以做出相同的动作。

这种技术一般是基于的GAN(生成对抗网络)来实现,今天我给大家分享一个开源项目,能够复现上面的效果,可以做些有趣的项目,也可以怀念故人。

1. 运行项目

项目地址:https://github.com/AliaksandrSiarohin/first-order-model

首先,git clone将项目下载到本地,进入项目安装依赖。

git clone https://github.com/AliaksandrSiarohin/first-order-model.git cd first-order-model pip install -r requirements.txt

然后,在项目首页Pre-trained checkpoint标题下,找到模型下载链接,下载模型文件,模型有很多,我用的是vox-adv-cpk.pth.tar。

准备好模型文件后,在项目根目录下执行下面命令即可。

python demo.py \ --config config/vox-adv-256.yaml \ --driving_video src_video.mp4 \ --source_image src_img.jpg \ --checkpoint weights/vox-adv-cpk.pth.tar

解释下参数:

- --config:模型配置文件,在源文件中有

- --driving_video:提供动作的视频

- --source_image:需要加动效的静态图片

- --checkpoint:刚刚下载的模型文件

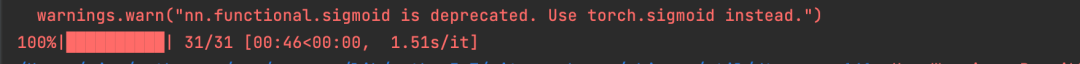

运行完成后,会看到如下输入。

该项目使用PyTorch搭建神经网络,支持GPU和CPU运行,所以如果你的电脑只有CPU,运行会比较慢。

我是在CPU下运行的,从上图可以看到,driving_video只有 31 帧。如果你也是CPU运行,最好控制driving_video视频的时长,不然运行时长会比较长。

有了该项目,可以自己做些比较有意思的尝试。

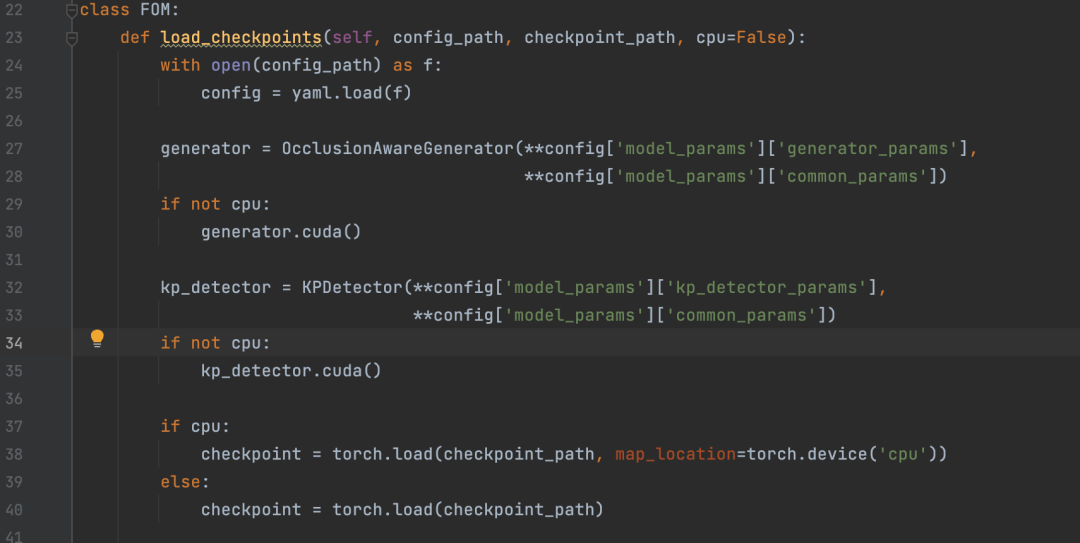

2. Python API

上面教大家按照官网在命令行运行该项目。

有些朋友可能想在Python项目中调用,所以我在demo.py中抽取了核心代码,封装了一个Pyhton API。

有需要的朋友可以下载这个文件,放到与first-order-model同一级的目录下,按照下面代码调用即可。

fom = FOM() # 查看驱动视频,驱动视频最好裁剪为480 x 640 大小的视频 driving_video = '' # 被驱动的画面 source_image = '' # 输出视频 result_video = '' # 驱动画面 fom.img_to_video(driving_video, source_image, result_video)

加载全部内容