使用python来玩一次股票代码详解

蚂蚁爱Python 人气:0准备工作

我们需要使用这些模块,通过pip安装即可。

后续使用的其它的模块都是Python自带的,

不需要安装,直接导入使用即可。

requests: 爬虫数据请求模块 pyecharts: 数据分析 可视化模块 pandas: 数据分析 可视化模块里面的设置模块(图表样式)

获取数据部分

爬虫的基本流程

思路分析

采集什么数据?怎么采集?

首先我们找到数据来源

代码实现

我们想要实现通过爬虫获取到数据,正常情况下有几个步骤:

发送请求获取数据解析数据保存数据

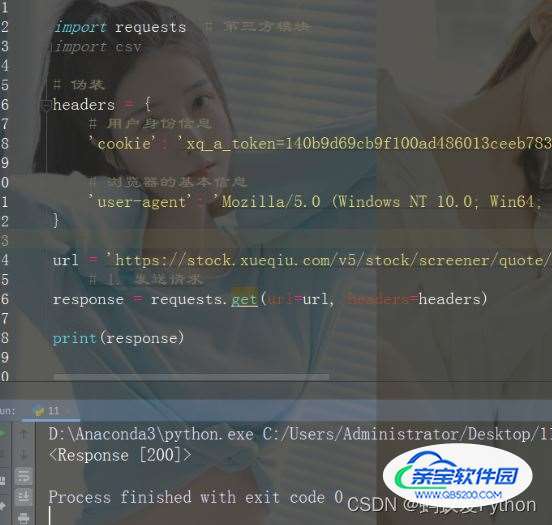

接下来我们来看代码 代码展示

导入需要使用的模块

import requests # 数据请求模块 import csv # 表格模块

发送请求

通过response模块来访问需要获取数据的地址

url = 'https://stock.xueqiu.com/v5/stock/screener/quote/list.json?page={page}&size=30&order=desc&orderby=percent&order_by=percent&market=CN&type=sh_sz'

requests.get(url=url)需要使用 cookie 来伪装一下,

cookie代表着用户身份信息。

当然光cookie是不够的,

咱们再加上当前网页的 user-agent

伪装加好之后,咱们就能得到一个相应结果,

先打印出来看看。

import requests # 第三方模块

import csv

# 伪装

headers = {

# 用户身份信息

'cookie': 's=bq119wflib; device_id=90ec0683f24e4d1dd28a383d87fa03c5; xq_a_token=df4b782b118f7f9cabab6989b39a24cb04685f95; xqat=df4b782b118f7f9cabab6989b39a24cb04685f95; xq_r_token=3ae1ada2a33de0f698daa53fb4e1b61edf335952; xq_id_token=evjkfkyJ0eXAiOiJKV1QiLCJhbGciOiJSUzI1NiJ9.eyJ1aWQiOi0xLCJpc3MiOiJ1YyIsImV4cCI6MTY3MjE4Njc1MSwiY3RtIjoxNjcwNTAxMjA5MTEyLCJjaWQiOiJkOWQwbjRBWnVwIn0.iuLASkwB6LkAYhG8X8HE-M7AM0n0QUULimW1C4bmkko-wwnPv8YgdakTC1Ju6TPQLjGuvfudhhMqHuSXqiWdOqVIjy_OMEj9L_HScDot-7kn63uc2lZbEdGnjyF3sDrqGBCpocuxTTwuSFuQoQ1lL7ZWLYOcvz2pRgCw64I0zLZ9LogQU8rNP-a_1Nc91V8moONFqPvjjnWD5Lt3JxqcuyJbmb86OpfJZRycnh1Gjnl0Aj1ltGa4sNGSMXoY2iNM8NB56LLIp9dztEwExiRSWlWZifpl9ERTIIpHFBq6L2lSTRKqXKb0V3McmgwQ1X0_MdNdLAZaLZjSIIcQgBU26T8Z4YBZ39dA; u=511670501221348; Hm_lvt_1db88642e346389874251b5a1eded6e3=1667994737,1670480781,1670501222; Hm_lpvt_1db88642e346389874251b5a1eded6e3=1670501922',

# 浏览器的基本信息

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36'

}

url = 'https://stock.xueqiu.com/v5/stock/screener/quote/list.json?page={page}&size=30&order=desc&orderby=percent&order_by=percent&market=CN&type=sh_sz'

# 1. 发送请求

response = requests.get(url=url, headers=headers)

print(response)

运行后出现 <Response [200]>求请求成功,

出现404就是访问不到资源,一般是被反爬了。

所以这时候我们需要加一个 referer 防盗链参数进去

'referer: https://xueqiu.com/hq'

如果加了还不行,

就是自己链接有问题了。

取数据的话 .json 就好了

import requests # 第三方模块

import csv

# 伪装

headers = {

# 用户身份信息

'cookie': 's=bq119wflib; device_id=90ec0683f24e4d1dd28a383d87fa03c5; xq_a_token=df4b782b118f7f9cabab6989b39a24cb04685f95; xqat=df4b782b118f7f9cabab6989b39a24cb04685f95; xq_r_token=3ae1ada2a33de0f698daa53fb4e1b61edf335952; xq_id_tokendjdjfvj=eyJ0eXAiOiJKV1QiLCJhbGciOiJSUzI1NiJ9.eyJ1aWQiOi0xLCJpc3MiOiJ1YyIsImV4cCI6MTY3MjE4Njc1MSwiY3RtIjoxNjcwNTAxMjA5MTEyLCJjaWQiOiJkOWQwbjRBWnVwIn0.iuLASkwB6LkAYhG8X8HE-M7AM0n0QUULimW1C4bmkko-wwnPv8YgdakTC1Ju6TPQLjGhMqHuSXqiWdOqVIjy_OMEj9L_HScDot-7kn63uc2lZbEdGnjyF3sDrqGBCpocuxTTwuSFuQoQ1lL7ZWLYOcvz2pRgCw64I0zLZ9LogQU8rNP-a_1Nc91V8moONFqPWD5Lt3JxqcuyJbmb86OpfJZRycnh1Gjnl0Aj1ltGa4sNGSMXoY2iNM8NB56LLIp9dztEwExiRSWlWZifpl9ERTIIpHFBq6L2lSTRKqXKb0V3McmgwQ1X0_MdNdLAZaLZjSIIcQgBU26T8Z4YBZ39dA; u=511670501221348; Hm_lvt_1db88642e346389874251b5a1eded6e3=1667994737,1670480781,1670501222; Hm_lpvt_1db88642e346389874251b5a1eded6e3=1670501922',

# 防盗链

'referer: https://xueqiu.com/hq'

# 浏览器的基本信息

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36'

}

url = 'https://stock.xueqiu.com/v5/stock/screener/quote/list.json?page={page}&size=30&order=desc&orderby=percent&order_by=percent&market=CN&type=sh_sz'

# 1. 发送请求

response = requests.get(url=url, headers=headers)

print(response.json())获取数据

什么是json数据?

以 {}/[] 所包裹起来的数据 {“”:“”, “”:“”}

除了 .json 还可以通过 .text 和 .content 来拿到数据,但是它们获取到的数据是一样。

.text 获取到的是字符串,文本内容。

.content 取到的是二进制数据,一般是图片/音频/视频内容。

json_data = response.json()

解析数据

解析数据就是提取数据,把我们想要的数据提取出来。

没学过字典的小伙伴,可以先学一下字典。

data_list = json_data['data']['list']

# data_list[0]

# data_list[1]

for i in range(0, len(data_list)):

symbol = data_list[i]['symbol']

name = data_list[i]['name']

current = data_list[i]['current']

chg = data_list[i]['chg']

percent = data_list[i]['percent']

current_year_percent = data_list[i]['current_year_percent']

volume = data_list[i]['volume']

amount = data_list[i]['amount']

turnover_rate = data_list[i]['turnover_rate']

pe_ttm = data_list[i]['pe_ttm']

dividend_yield = data_list[i]['dividend_yield']

market_capital = data_list[i]['market_capital']

print(symbol, name, current, chg, percent, current_year_percent, volume, amount, turnover_rate, pe_ttm, dividend_yield, market_capital)保存数据

csv_writer.writerow([symbol, name, current, chg, percent, current_year_percent, volume, amount, turnover_rate, pe_ttm, dividend_yield, market_capital])

数据可视化分析

导入需要使用的模块

import pandas as pd # 做表格数据处理模块 from pyecharts.charts import Bar # 可视化模块 from pyecharts import options as opts # 可视化模块里面的设置模块(图表样式)

读取数据

df = pd.read_csv('股票.csv')

x = list(df['股票名称'].values)

y = list(df['成交量'].values)

c = (

Bar()

.add_xaxis(x[:10])

.add_yaxis("成交额", y[:10])

.set_global_opts(

xaxis_opts=opts.AxisOpts(axislabel_opts=opts.LabelOpts(rotate=-15)),

title_opts=opts.TitleOpts(title="Bar-旋转X轴标签", subtitle="解决标签名字过长的问题"),

)

.render("成交量图表.html")加载全部内容